Alinear la inteligencia artificial con las estrategias educativas y prácticas didácticas; evitar que la tecnología sustituya al docente; procurar precisión, transparencia y manejo ético, y garantizar la confidencialidad de los datos utilizados son algunas recomendaciones que ofreció la experta española Alicia García-Holgado, durante un simposio organizado por la UCAB

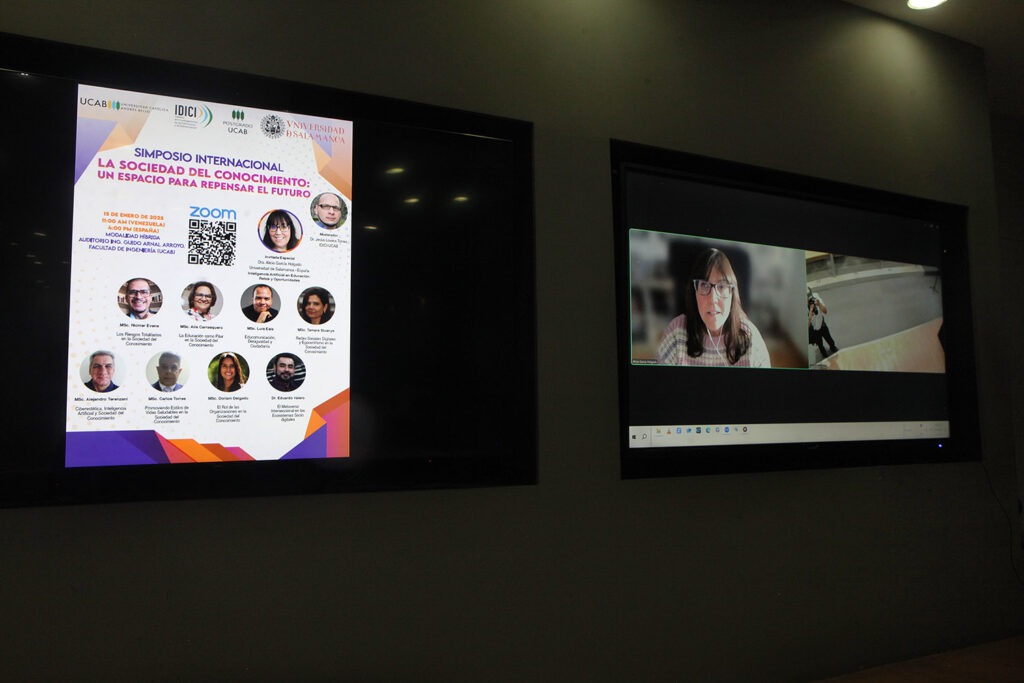

El Instituto de Investigaciones de la Información y Comunicación (IDICI) y el Doctorado en Comunicaciones en la Sociedad del Conocimiento de la UCAB llevaron adelante el simposio titulado «La sociedad del conocimiento: un espacio para repensar el futuro».

El evento, que tuvo lugar el pasado 15 de enero, reunió a un grupo de estudiantes del doctorado, así como a investigadores y profesores del área, quienes compartieron adelantos sobre los temas de investigación que están desarrollando.

En el marco de la actividad, la profesora Alicia García-Holgado -ingeniero informático, doctora en Formación en la Sociedad del Conocimiento, investigadora y docente de la Universidad de Salamanca– dictó la ponencia central, titulada «Inteligencia artificial (IA) en educación: oportunidades y retos».

Durante su intervención, realizada de manera remota desde España, la experta resaltó la necesidad de integrar esta herramienta en el ámbito educativo.

«Evitarlo no nos llevará a ningún lado; que el alumnado comprenda y aprenda a manejarlas. Será necesario seguir ajustando todos estos modelos y adaptarlos a las especificidades del contexto donde se utilizará. También es imperativo formar a desarrolladores y a usuarios en el uso de la IA y garantizar que se comprendan los riesgos», comentó.

Principios para la educación y la IA

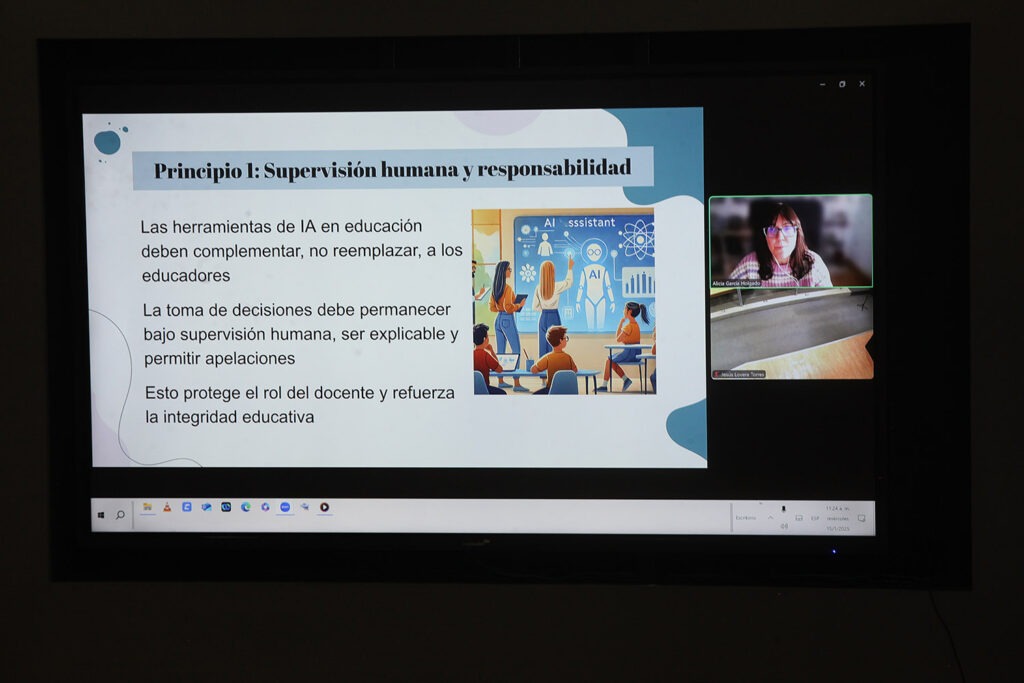

En su conferencia, Alicia García-Holgado expuso siete principios para comprender y utilizar responsablemente la inteligencia artificial en entornos educativos.

El primero de ellos, «Supervisión humana y responsabilidad», supone trabajar para que la IA no sea el foco del aprendizaje y para que no sustituya la labor del docente.

«No podemos dejar que la IA haga los programas, que sea quien enseña. Es necesario que el ser humano siga guiando los procesos, gestionando la enseñanza y el aprendizaje; y que esto sea una herramienta más», dijo la experta, quien alertó que no es el camino que se debe perseguir desde la visión formativa.

La investigadora mencionó la «Garantía de confidencialidad» como segundo precepto, que guarda relación con el cuidado de los datos, tanto de alumnos y docentes como de las instituciones educativas: «Al final muchos de estos modelos no son abiertos, son manejados por empresas y no se sabe cómo manejan los datos que se introducen en la IA. Es importe resguardar la privacidad y confidencialidad de los datos».

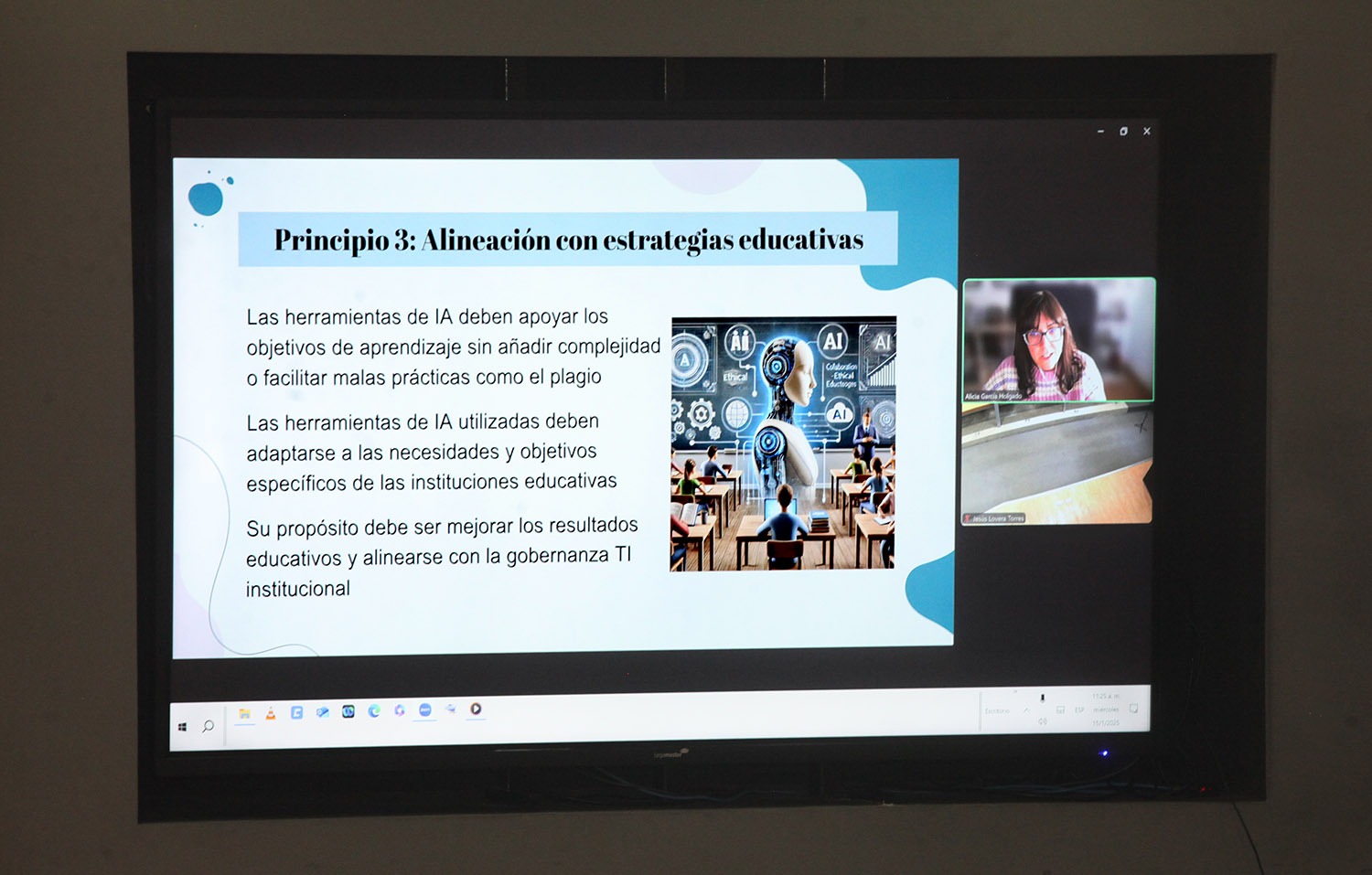

El tercer y cuarto principio referidos por la especialista («Alineación con las estrategias educativas» y «Alineación con las prácticas didácticas») están estrechamente relacionados entre sí y aluden a que la IA debe apoyar el aprendizaje de los alumnos.

«La tecnología es un elemento más y debes incorporarla como parte de las estrategias y no viceversa. No se deben construir prácticas en torno a una herramienta que vamos a utilizar», resaltó.

«Precisión y explicabilidad» fue el quinto principio del uso de la IA en la educación apuntado por García-Holgado, el cual implica promover la capacidad crítica del usuario. Es decir, que pueda explicar cómo la IA ha llegado a un resultado determinado. «Hay que intentar asegurar la fiabilidad de los sistemas», dijo.

El sexto precepto que mencionó fue trabajar para tener una «Interfaz y comportamiento integral» de las IA, es decir, que deben ser sencillas, claras y transparentes para los usuarios.

Finalmente, la profesora apuntó que el séptimo principio: «Formación ética y transparencia» es de suma relevancia para aquellos que incorporen la IA en su día a día, así como en el salón de clases.

«Los modelos de IA que se utilicen deben ser transparentes, conocer cómo fueron entrenados y aplicar principios éticos a la hora de entrenarlos para evitar datos erróneos, estereotipos e intentar evitar promover ciertas ideas o formas de pensamientos y no discriminar a grupos de la población», indicó.

Incentivar el pensamiento crítico

La profesora de la Universidad de Salamanca mencionó los diferentes problemas o complejidades que representa la inteligencia artificial no solo para la educación, sino para la sociedad en general, sobre todo ahora que se ha expandido de forma rápida entre jóvenes y adultos.

La investigadora comentó que la IA generativa puede ofrecer resultados sesgados, tomando en cuenta que el contenido del cual la IA aprende y obtiene información puede responder a intereses, pensamientos e ideologías particulares.

Advirtió que esto supone un un «riesgo de fiabilidad» importante, ante el cual los usuarios requieren de un alto nivel de conocimiento o, al menos, de pensamiento crítico.

«Uno de los grandes desafíos es el pensamiento crítico del que se venía hablando desde hace tiempo en la sociedad de conocimiento. Debemos continuar incentivándolo y trabajando el conjunto de competencias y habilidades asociadas a ello (…) Al final, si no somos críticos, los sesgos son amplios», señaló García-Holgado.

Partiendo de esto, la ingeniero insistió en que es momento de revisar la ética y reformular la manera en que se imparte la docencia, así como replantear la forma en que se aprende, lo cual aplica no solo para los alumnos, sino para los docentes.

«No podemos seguir enseñando o aprendiendo como hacíamos antes de este tipo de herramientas. (…) La tecnología no es buena ni mala, pero sí tendrá un impacto en nuestra sociedad y en los sistemas que se desarrollan. Hay que tener cuidado con la neutralidad», concluyó.

Diálogo sobre la sociedad del conocimiento

Además de la ponencia de García-Holgado, el simposio organizado por la UCAB incluyó la presentación de otros ocho profesionales del área de la comunicación y la política, como Nicmer Evans, Alis Carrasquero, Luis Esis, Tamara Slusnys, Alejandro Terenzani, Carlos Torres, Doriam Delgado y Eduardo Valero, todos estudiantes del doctorado.

Los expositores abordaron temas como «Redes sociales y egocentrismo», «Metaverso interseccional en los ecosistemas sociodigitales», «Concepción de la salud en la sociedad del conocimiento», «Educomunicación, desigualdad y ciduadanía» y «Riesgos totalitarios en la sociedad del conocimiento», entre otros.

De acuerdo con Jesús Lovera -investigador del IDICI UCAB y organizador del evento- la actividad representó un espacio para dialogar con los doctorandos sobre los cambios en la ciencia y tecnología, y cómo los mismos «generan impacto en el comportamiento humano y el desarrollo de las sociedades».

Los interesados en conocer más sobre el Doctorado en Comunicaciones en la Sociedad del Conocimiento pueden hacer clic en este enlace: https://postgrado.ucab.edu.ve/estudio/doctorado-en-comunicaciones-en-la-sociedad-del-conocimiento/

♦Texto: Grace Lafontant León/ Fotos: Manuel Sardá

Ucabistas ganaron concurso de mediación y arbitraje con asistente legal basado en IA